2024-06-16T00:00:00Z

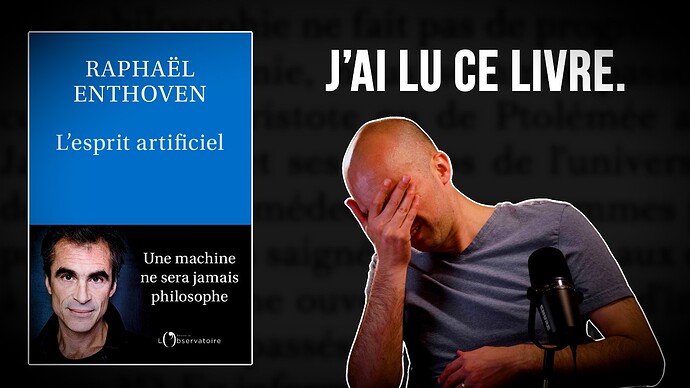

Analyse critique : la controverse Raphaël Enthoven contre l’Intelligence Artificielle

Après celle de Luc Julia dont nous avions déjà parlé

[!Success] Ecoutez le débat contradictoire

[!Note]

Le jugement definitif du philosophe Enthoven sur l’intelligence artificielle, un domaine qu’il ne connaît absolument pas, et n’a visiblement jamais expérimenté, me rappelle une anecdote. En 1992, je discutais avec quelqu’un qui était spécialiste du jeu d’échecs et qui m’affirmait que jamais une machine ne battrait un grand maître aux échecs. La chose s’est produite en 1997, très peu de temps après son affirmation péremptoire.

1. Introduction : Contexte et Enjeux d’un Débat Médiatique

Le débat public autour de l’intelligence artificielle a récemment été marqué par la controverse opposant le philosophe médiatique Raphaël Enthoven à l’IA générative, incarnée par ChatGPT. Cette confrontation a cristallisé une tension fondamentale entre une vision humaniste traditionnelle et les avancées technologiques disruptives. Au cœur de cette controverse se trouve la thèse centrale d’Enthoven, affirmant l’incapacité structurelle et définitive de la machine à philosopher, une limite qu’il déclare infranchissable « à jamais ». Face à cette affirmation, le vidéaste et analyste Monsieur Phi a proposé une réfutation expérimentale rigoureuse. Ce document se propose d’analyser de manière objective les arguments en présence, la méthodologie de la démonstration d’Enthoven, et les implications philosophiques plus larges de ce débat, qui constitue une étude de cas éclairante sur la collision entre les humanités classiques et les méthodes d’enquête empiriques, nées du numérique. Nous commencerons par examiner en détail la position défendue par Raphaël Enthoven.

2. La Thèse d’Enthoven : Une Limite Ontologique à l’Intelligence Artificielle

Pour évaluer la validité d’une affirmation, il est stratégiquement essentiel d’en comprendre précisément la structure et les fondements. La thèse de Raphaël Enthoven, bien que martelée avec force, repose sur un argument unique et une expérience singulière. Cette section a pour objectif de décomposer son argument principal, la preuve qu’il avance pour le soutenir, et les soubassements philosophiques qui l’animent.

2.1. L’Argument Central : La « Problématique » comme Test Ultime de la Pensée

L’argument principal de Raphaël Enthoven repose sur une compétence spécifique qu’il érige en test ultime de la pensée : la capacité à construire une problématique de dissertation philosophique. Selon lui, cette faculté n’est pas une simple tâche technique, mais l’incarnation d’un « petit pas de côté » que seule la conscience humaine peut effectuer. Il s’agit de la capacité à identifier une tension interne dans un sujet, à manifester le problème que pose la question elle-même. Pour Enthoven, la machine est, par définition, privée de cette capacité. Son affirmation est catégorique et définitive, transcendant les progrès technologiques futurs : « L’IA de dans 1000 ans sera toujours aussi impuissante à trouver la problématique d’un sujet de philosophie. » Cette incapacité n’est donc pas conjoncturelle, mais ontologique.

2.2. La Preuve par l’Exemple : Le « Match des Intelligences »

L’ensemble de l’argumentation d’Enthoven prend sa source et sa justification dans un unique événement : un « match » organisé lors du baccalauréat de philosophie, l’opposant à ChatGPT-4. Sur le sujet « Le bonheur est-il affaire de raison ? », la copie du philosophe a obtenu la note de 20/20, tandis que celle de l’IA a reçu un 11/20. Enthoven a immédiatement interprété ce résultat non comme une performance relative, mais comme une preuve irréfutable de la supériorité de nature de l’humain. Il a qualifié à de multiples reprises l’événement de « faux match », signifiant par là qu’il n’y avait jamais eu de compétition réelle, l’une des deux « intelligences » étant, selon lui, fondamentalement incapable de participer à l’épreuve de la pensée. Cette unique donnée, issue d’une expérience biaisée, fut ainsi élevée du statut de simple mesure de performance à celui de verdict définitif sur la nature ontologique de l’intelligence artificielle, un saut philosophique qui révèle ses présupposés fondamentaux.

2.3. Le Fondement Philosophique : L’Étoffe Insaisissable de l’Humanité

Au-delà de la performance observable, la position d’Enthoven est sous-tendue par une posture philosophique qui s’apparente à un dualisme ou à un vitalisme. Il affirme que la machine est « inapte à synthétiser l’étoffe dont l’humanité est faite » et insiste sur le fait que « nos cerveaux ne sont pas de silicium ». Pour lui, la différence entre l’humain et l’IA n’est pas une question de complexité ou de puissance de calcul, mais bien une différence de nature fondamentale. La pensée humaine serait issue d’un « je-ne-sais-quoi » irréductible, d’une expérience vécue (la mortalité, le désarroi) que la machine ne peut que « singer » sans jamais l’éprouver.

La thèse étant ainsi posée dans ses dimensions empiriques et métaphysiques, il convient maintenant d’en examiner la rigueur méthodologique.

3. Examen Critique de la Méthodologie Enthovenienne

La solidité d’une thèse, particulièrement lorsqu’elle se veut définitive, dépend de la rigueur de la méthodologie qui la soutient. Or, un examen attentif de la démarche de Raphaël Enthoven, tant dans son livre que dans ses interventions, révèle des faiblesses structurelles importantes. Cette section se propose d’analyser de manière critique la construction de son argumentation, son rapport aux sources techniques, et la validité de l’expérience sur laquelle il fonde l’ensemble de sa démonstration.

3.1. Une Absence de Contenu Original

L’analyse du livre d’Enthoven sur le sujet révèle qu’il s’agit moins d’une enquête originale que d’un « patchwork » de textes préexistants et de digressions largement déconnectées du thème de l’IA. De longs passages sont consacrés à Proust, à l’amour ou à des aphorismes sur la philosophie, recyclant souvent des chroniques antérieures. Il est frappant de constater que les deux tiers de l’ouvrage ne traitent pas de l’intelligence artificielle. Les rares sections pertinentes se contentent de résumer une source secondaire, en l’occurrence un dossier du magazine L’Express, sans apporter de recherche ou d’analyse personnelle.

3.2. Un Manque de Curiosité et des Erreurs Techniques

La démarche d’Enthoven est marquée par une absence manifeste de curiosité pour le fonctionnement réel de la technologie qu’il critique. Le terme technique de « modèle de langage » (LLM) n’apparaît à aucun moment dans son livre. De plus, il commet des erreurs factuelles significatives, notamment lorsqu’il décrit les IA de jeu (Go, échecs) comme explorant « indifféremment l’ensemble des possibilités », une description caricaturale et techniquement fausse, particulièrement pour les algorithmes modernes de type AlphaZero. Ce manque de rigueur technique affaiblit considérablement la crédibilité de ses conclusions générales.

3.3. La Généralisation abusive d’une Expérience Viciée

Le pilier de la thèse d’Enthoven – le « match » contre ChatGPT – repose sur une expérience profondément viciée. Le prompt (l’instruction donnée à l’IA) utilisé pour générer la dissertation était « très mauvais » et « désordonné ». Il orientait explicitement la machine vers la production d’un « catalogue d’auteurs », tout en lui imposant des contraintes contre-productives (comme l’ajout d’humour). L’ironie principale est qu’Enthoven fonde toute sa thèse sur l’absence de problématique dans le texte de l’IA, alors que le prompt ne demandait à aucun moment d’en produire une. Il balaye cette objection cruciale d’un revers de main, moquant l’idée qu’« il suffirait de demander à la machine d’être intelligente » sans jamais avoir tenté l’expérience lui-même.

C’est précisément pour corriger ces biais méthodologiques et tester rigoureusement la thèse d’Enthoven qu’une nouvelle expérience a été conçue.

4. La Réfutation Expérimentale : Un Test de Turing Philosophique

En réponse directe à l’affirmation centrale et univoque de Raphaël Enthoven, une expérience a été menée pour évaluer si sa thèse résistait à une confrontation empirique rigoureuse. Ce « test de Turing philosophique » visait à déterminer objectivement si des experts, en l’occurrence des professeurs de philosophie, pouvaient distinguer de manière fiable une problématique générée par une IA d’une problématique rédigée par un humain.

4.1. Protocole Expérimental

La méthodologie du test a été conçue pour être simple et robuste. Pour chacun des dix sujets de dissertation retenus, trois textes de problématique ont été présentés aux participants de manière aléatoire :

- Un texte de référence rédigé par un professeur de philosophie humain (incluant le texte d’Enthoven lui-même pour un des sujets).

- Un texte généré par GPT-4 avec un prompt « simple », demandant de construire une problématique selon des indications méthodologiques claires (opposer une thèse à une objection, développer la tension).

- Un texte généré par GPT-4 avec un prompt conçu pour imiter le style littéraire et paradoxal de Raphaël Enthoven.

Les participants devaient ensuite noter la « qualité philosophique » de chaque texte, puis identifier celui qu’ils pensaient avoir été écrit par l’humain.

4.2. Résultats Globaux : L’Indiscernabilité Statistique

Les résultats globaux, portant sur plus de 1500 participants, démontrent une incapacité généralisée à distinguer l’origine des textes.

- Taux de réussite moyen : Le taux de bonne réponse s’élève à 38 %, un score à peine supérieur à une réponse purement aléatoire (33,33 %).

- Proportion de participants performant mieux que le hasard : Seuls 47 % des participants ont obtenu un score supérieur au hasard, ce qui signifie qu’une majorité a fait aussi bien ou moins bien que le hasard.

- Niveau de confiance des participants : Les participants ont largement surestimé leurs capacités, prédisant en moyenne un taux de réussite de 50 %, bien au-dessus de la performance réelle.

4.3. L’Évaluation par les Experts

Le groupe le plus pertinent pour évaluer la thèse d’Enthoven était celui des 94 professeurs de philosophie participants. Leurs résultats, bien que supérieurs à la moyenne, restent très révélateurs. Ils ont atteint une moyenne de 57 % de bonnes réponses. Si ce score est significativement meilleur que le hasard, il reste extrêmement faible et très éloigné des 90 % ou plus qu’impliquerait une distinction évidente et une « limite absolue » entre la pensée humaine et la production de l’IA. L’indiscernabilité reste donc très élevée, même pour des spécialistes.

4.4. Analyse Qualitative : La Qualité Philosophique Perçue

L’évaluation de la qualité philosophique des textes par les participants offre la conclusion la plus surprenante. Les textes générés par l’IA avec un prompt simple et méthodologique ont été jugés, en moyenne, comme étant de meilleure qualité que les textes rédigés par les humains.

| Type de Texte | Note Moyenne (Tous Participants) |

|---|---|

| GPT-4 (Prompt Simple) | 6.5 / 10 |

| Humain | Légèrement supérieure à 6/10 |

| GPT-4 (Style Enthoven) | 5.75 / 10 |

Cette conclusion a été confirmée par les professeurs de philosophie, qui ont également noté plus sévèrement les textes humains que les textes générés par le prompt simple. Le cas le plus emblématique de cette expérience est sans doute la confrontation directe avec le texte d’Enthoven lui-même.

5. Étude de Cas : Le Texte d’Enthoven face à l’IA

Pour éprouver définitivement la thèse selon laquelle aucune machine ne pourrait problématiser comme un philosophe, l’expérience a inclus le texte même rédigé par Raphaël Enthoven lors de son « match » sur le sujet « Le bonheur est-il affaire de raison ? ». Les résultats de cette confrontation directe sont sans appel et constituent une réfutation directe de ses affirmations.

5.1. Verdict sur la Qualité Philosophique

Le texte original d’Enthoven a été jugé philosophiquement inférieur à celui généré par une IA dotée d’un simple prompt méthodologique.

- Texte de GPT-4 (Prompt Simple) : 6,41 / 10

- Texte de Raphaël Enthoven (Humain) : 5,59 / 10

- Texte de GPT-4 (Style Enthoven) : 4,79 / 10

De manière accablante, cette évaluation a été corroborée par le panel d’experts : les professeurs de philosophie ont attribué au texte d’Enthoven non seulement une note inférieure à celle de tous les textes générés par le prompt simple de l’IA, mais aussi la note la plus basse parmi tous les textes humains inclus dans l’expérience.

5.2. Verdict sur l’Origine du Texte

L’identification de l’auteur humain s’est avérée tout aussi problématique pour les participants. Seul un tiers d’entre eux a correctement identifié le texte d’Enthoven comme étant l’œuvre humaine. De manière encore plus significative, près de la moitié des participants a cru à tort que le texte de GPT-4 (prompt simple) était celui de l’humain, lui attribuant ainsi la paternité de l’œuvre jugée la plus qualitative. Cette réfutation est d’autant plus cinglante qu’elle invalide une prédiction spécifique et répétée d’Enthoven : il avait insisté sur le fait que seule la pensée humaine pouvait concevoir de problématiser le sujet en opposant le bonheur comme sentiment à la froide rationalité. Or, l’expérience démontre que GPT-4 a non seulement eu cette « idée », mais l’a exécutée d’une manière jugée supérieure à la sienne.

Face à une réfutation empirique aussi claire, la question se pose de savoir comment l’argumentation d’Enthoven peut évoluer.

6. De l’Affirmation Empirique au Dogme Métaphysique

Lorsqu’une affirmation empirique et observable est falsifiée par l’expérience, son auteur est souvent contraint de la reformuler sur un plan non-falsifiable pour en préserver la validité apparente. L’analyse de la posture philosophique d’Enthoven permet d’anticiper ce glissement argumentatif, qui déplace le débat d’une question de performance à une question de principe métaphysique.

6.1. La Parade de la « Simulation »

La réponse la plus probable à cette réfutation expérimentale consiste à affirmer que l’IA ne fait que « singer » ou « simuler » la pensée. Selon cet argument, même si le résultat est indiscernable, voire supérieur, il resterait un « simulacre » inauthentique. La machine ne ferait pas l’expérience subjective de la pensée ; elle n’« éprouverait » rien, ne mettrait pas « sa vie en jeu ». Cet argument déplace habilement le critère de la performance observable, qui est testable, vers une expérience interne et subjective, qui est par nature inaccessible et invérifiable.

6.2. Le Repli sur une Position Infalsifiable

Cette posture conduit à un repli sur ce qui s’apparente à un « dogme vitaliste-dualiste ». L’affirmation « les machines ne pensent pas » n’est plus une prédiction sur leurs capacités, mais une tautologie : « les machines ne pensent pas parce que ce sont des machines ». Déconnectée de toute performance observable, cette position devient infalsifiable mais également injustifiable. Elle relève d’une forme de « bigoterie humaniste » ou de « discrimination à l’égard du silicium », postulant une supériorité de nature du substrat biologique sans pouvoir en démontrer les effets objectifs.

6.3. Le Dilemme : Une Thèse Fausse ou Vide

En définitive, la thèse de Raphaël Enthoven est confrontée à un dilemme qui la condamne soit à l’erreur, soit à la vacuité. Les deux branches de l’alternative sont les suivantes :

- Soit son affirmation porte sur des capacités observables et mesurables (comme la faculté de créer une problématique philosophique de qualité), et dans ce cas, l’expérience a démontré qu’elle est empiriquement fausse.

- Soit son affirmation est une déclaration de principe sur la « nature » de la pensée, indépendante de toute performance ou capacité, et dans ce cas, elle est philosophiquement vide de contenu empirique et se réduit à un acte de foi.

Cette impasse logique et empirique invite à une conclusion plus large sur la place et la responsabilité du discours intellectuel dans le débat public sur l’intelligence artificielle.

7. Conclusion : Responsabilité Intellectuelle à l’Ère de l’IA

L’analyse détaillée de la controverse entre Raphaël Enthoven et l’intelligence artificielle démontre que l’argument central et unique du philosophe a été réfuté par une expérience rigoureuse. Sa thèse, selon laquelle une machine serait « à jamais » incapable de produire une problématique philosophique, s’est avérée non seulement fausse, mais ironiquement invalidée par la performance même de son propre texte, jugé inférieur à celui d’une IA par des pairs.

Cette controverse met en lumière la confrontation de deux méthodologies intellectuelles. D’une part, une approche fondée sur l’autorité et l’aphorisme de fauteuil, qui émet des jugements définitifs à partir d’une expérience unique et biaisée. D’autre part, une démarche issue de la philosophie des sciences et des humanités numériques, qui privilégie les hypothèses falsifiables et la vérification expérimentale. La leçon centrale de cet épisode réside dans la démonstration de la supériorité de la seconde approche pour aborder des sujets techniques et complexes. Dans un débat public aussi crucial que celui sur l’avenir de l’IA, la responsabilité intellectuelle impose la rigueur. Une parole d’autorité qui, par manque de curiosité et de méthode, « prend de la place pour créer de l’ignorance » n’est pas une contribution neutre ; elle est, comme le souligne l’analyse de Monsieur Phi, « franchement négative », obscurcissant les enjeux réels au profit d’affirmations dogmatiques et infondées.